Nota

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare ad accedere o modificare le directory.

L'accesso a questa pagina richiede l'autorizzazione. È possibile provare a modificare le directory.

Importante

L'elaborazione prioritaria è in anteprima e disponibile su invito. Registrarsi qui per ricevere una notifica quando diventa più disponibile.

Questa anteprima viene fornita senza un contratto di servizio e non è consigliata per i carichi di lavoro di produzione. Alcune funzionalità potrebbero non essere supportate o potrebbero presentare funzionalità limitate. Per altre informazioni, vedere le Condizioni supplementari per l'uso delle anteprime di Microsoft Azure.

L'elaborazione prioritaria offre prestazioni a bassa latenza con la flessibilità del pagamento in base al consumo. Opera su un modello di token con pagamento in base al consumo, offrendo tempi di risposta rapidi senza impegni di contratto a lungo termine. In questo articolo viene abilitata l'elaborazione delle priorità in una distribuzione del modello, si verifica il livello di servizio che ha elaborato le richieste e si monitorano i costi associati.

Prerequisiti

- Una sottoscrizione di Azure: crearne una gratuitamente.

- Progetto Microsoft Foundry con un modello di distribuzione del tipo

GlobalStandardoDataZoneStandarddistribuito. - Accettazione nell'anteprima dell'elaborazione prioritaria. Registrarsi qui per ricevere una notifica quando l'elaborazione della priorità diventa più disponibile.

- Versione

2025-10-01-previewdell'API o successiva.

Informazioni generali

Vantaggi

- Bassa latenza prevedibile: generazione di token più veloce e coerente.

- Flessibilità facile da usare: come l'elaborazione standard con pagamento in base al consumo, l'elaborazione della priorità di accesso su base flessibile e con pagamento in base al consumo anziché richiedere il provisioning e le prenotazioni in anticipo.

Casi d'uso chiave

- Latenza coerente e bassa per le esperienze utente reattive.

- Semplicità con pagamento in base al consumo senza impegni a lungo termine.

- Traffico in ore lavorative o con picchi che trae vantaggio da prestazioni scalabili e convenienti. Facoltativamente, è possibile combinare l'elaborazione prioritaria con le Provisioned Throughput Units (PTU) per la capacità allo stato stazionario e l'ottimizzazione dei costi.

Limits

Limite di rampa: Un rapido incremento dei token di elaborazione prioritari al minuto potrebbe portare a raggiungere i limiti di velocità di rampa. Se si supera il limite di velocità di rampa, il servizio potrebbe inviare traffico aggiuntivo all'elaborazione standard.

Quota: L'elaborazione prioritaria usa la stessa quota dell'elaborazione standard. Ciò significa che la tua distribuzione con elaborazione prioritaria utilizza una quota della tua allocazione standard esistente.

Supporto per l'elaborazione prioritaria

Disponibilità del modello standard globale

| Area geografica | gpt-4.1, 2025-04-14 |

|---|---|

| eastus 2 | ✅ |

| SveziaCentral | ✅ |

| westus3 | ✅ |

Annotazioni

La disponibilità del modello e dell'area potrebbe espandersi durante il periodo di anteprima. Controllare questa pagina per gli aggiornamenti.

Problemi noti

L'elaborazione prioritaria presenta attualmente queste limitazioni e sono in corso correzioni:

Limite di contesto lungo per gpt-4.1: Il servizio non supporta le richieste che superano 128.000 token e restituisce un errore HTTP 400.

Nessun supporto per lo spillover PTU: Il servizio non supporta ancora lo spillover PTU in una distribuzione con abilitazione all'elaborazione prioritaria. Se è necessario un comportamento di spillover, implementare una logica personalizzata, ad esempio usando Gestione API di Azure.

Valore service_tier errato quando si usa lo streaming nell'API Risposte: Quando si trasmetteno risposte tramite l'API Risposte, il

service_tiercampo potrebbe restituire erroneamente "priorità", anche se i vincoli di capacità o i limiti di rampa hanno causato la gestione della richiesta dal livello standard. In questo caso, il valore previsto perservice_tierè "default".

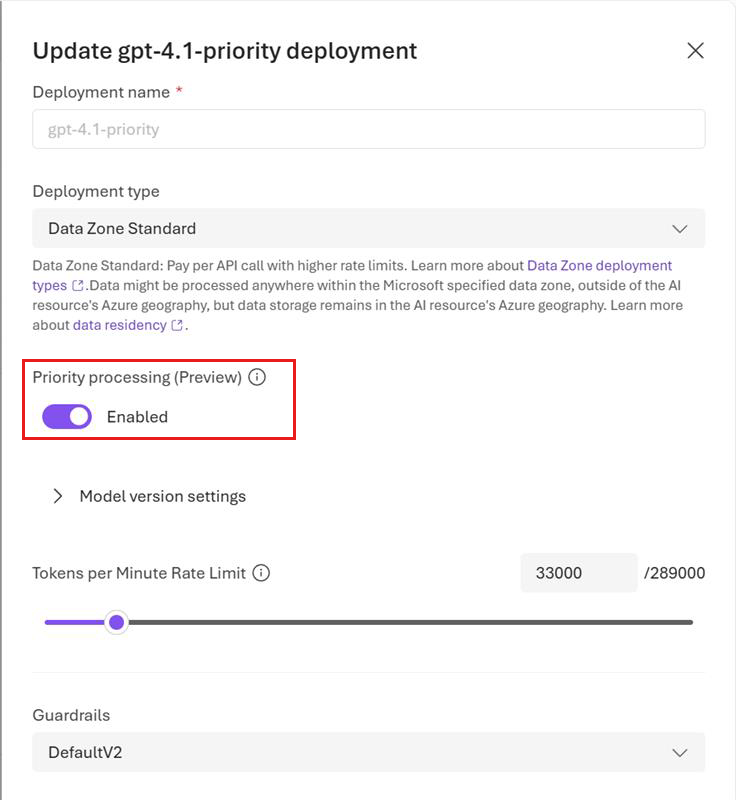

Abilitare il processamento prioritario a livello di distribuzione

È possibile abilitare l'elaborazione della priorità a livello di distribuzione e (facoltativamente) a livello di richiesta.

Nel portale di Microsoft Foundry è possibile abilitare l'elaborazione della priorità durante la configurazione della distribuzione. Attivare l'interruttore Elaborazione priorità (anteprima) nella pagina dei dettagli della distribuzione quando si crea la distribuzione o si aggiorna l'impostazione di un modello distribuito modificando i dettagli della distribuzione.

Annotazioni

Se si preferisce usare il codice per abilitare l'elaborazione della priorità a livello di distribuzione, è possibile farlo tramite l'API REST per la distribuzione impostando l'attributo service_tier come indicato di seguito: "properties" : {"service_tier" : "priority"}. I valori consentiti per l'attributo service_tier sono default e priority.

default implica l'elaborazione standard, mentre priority abilita l'elaborazione prioritaria.

Dopo aver impostato una distribuzione del modello per l'uso dell'elaborazione prioritaria, è possibile iniziare a inviare richieste al modello.

Visualizzare le metriche di utilizzo

È possibile visualizzare la misura di utilizzo per la risorsa nella sezione Monitoraggio di Azure nel portale di Azure.

Per visualizzare il volume di richieste elaborate dall'elaborazione standard rispetto all'elaborazione con priorità, suddivise per il livello di servizio (standard o priorità) presente nella richiesta originale:

- Accedi a https://portal.azure.com.

- Passare alla risorsa OpenAI di Azure e selezionare l'opzione Metriche nel riquadro di spostamento a sinistra.

- Nella pagina delle metriche aggiungere la metrica Richieste OpenAI di Azure . È anche possibile selezionare altre metriche come latenza OpenAI di Azure, l'utilizzo di Azure OpenAI e altri.

- Selezionare Aggiungi filtro per selezionare la distribuzione standard per la quale sono state elaborate le richieste di elaborazione prioritarie.

- Selezionare Applica suddivisione per suddividere i valori per ServiceTierRequest e ServiceTierResponse.

Per altre informazioni sul monitoraggio delle distribuzioni, vedere Monitorare Azure OpenAI.

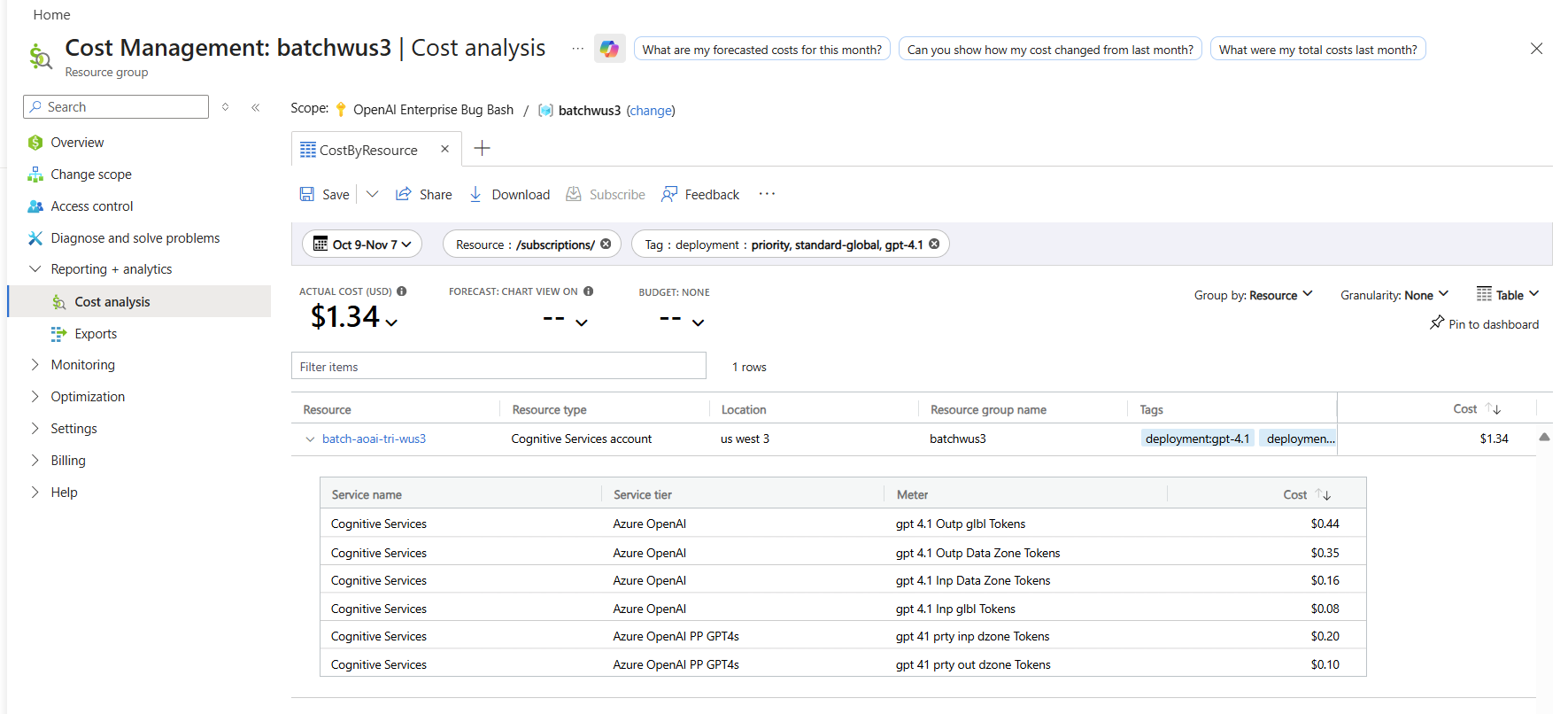

Monitorare i costi

È possibile visualizzare una suddivisione dei costi per le richieste di priorità e standard nella pagina di analisi dei costi del portale di Azure filtrando il nome della distribuzione e i tag di fatturazione come indicato di seguito:

- Passare alla pagina di analisi dei costi nel portale di Azure.

- (Facoltativo) Filtrare in base alla risorsa.

- Per filtrare in base al nome della distribuzione: aggiungere un filtro per il tag> di fatturazione, selezionare distribuzione come valore e quindi scegliere il nome della distribuzione.

Per informazioni sui prezzi per l'elaborazione prioritaria, vedere la panoramica dei prezzi del servizio OpenAI di Azure.

Abilitare l'elaborazione della priorità a livello di richiesta

L'abilitazione dell'elaborazione della priorità a livello di richiesta è facoltativa. Sia l'API di completamento della chat che l'API delle risposte hanno un attributo service_tier facoltativo che specifica il tipo di elaborazione da usare per la gestione di una richiesta. Nell'esempio seguente viene illustrato come impostare service_tier su priority in una richiesta di risposta.

curl -X POST https://YOUR-RESOURCE-NAME.openai.azure.com/openai/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $AZURE_OPENAI_AUTH_TOKEN" \

-d '{

"model": "gpt-4.1",

"input": "This is a test",

"service_tier": "priority"

}'

Usare l'attributo service_tier per eseguire l'override dell'impostazione a livello di distribuzione.

service_tier può accettare i valori auto, defaulte priority.

Se non si imposta l'attributo, per impostazione predefinita viene impostato su

auto.service_tier = autoindica che la richiesta usa il livello di servizio configurato nella distribuzione.service_tier = defaultindica che la richiesta usa i prezzi e le prestazioni standard per il modello selezionato.service_tier = priorityindica che la richiesta usa il servizio di elaborazione prioritario.

La tabella seguente riepiloga il livello di servizio che elabora le richieste in base alle impostazioni a livello di distribuzione e a livello di richiesta per service_tier.

| Impostazione a livello di distribuzione | Impostazione a livello di richiesta | Richiesta elaborata dal livello di servizio |

|---|---|---|

| impostazione predefinita | auto, impostazione predefinita | Normale |

| impostazione predefinita | priorità | Elaborazione prioritaria |

| priorità | automobile, priorità | Elaborazione prioritaria |

| priorità | impostazione predefinita | Normale |

Obiettivo di latenza

| Argomento | gpt-4.1, 2025-04-14 |

|---|---|

| Valore di destinazione della latenza | 99% > 80 token al secondo* |

* Calcolata come latenza di richiesta p50 sulla base di 5 minuti.

Limiti di velocità di salita

Per garantire prestazioni costantemente elevate per tutti i clienti, pur fornendo prezzi su richiesta e flessibili, l'elaborazione prioritaria impone limiti di velocità di incremento. Attualmente, il limite di velocità di rampa viene definito come aumento del traffico di oltre 50% token al minuto in meno di 15 minuti.

Condizioni di downgrade

Se le prestazioni di elaborazione delle priorità diminuiscono e il traffico di un cliente aumenta troppo rapidamente, il servizio potrebbe effettuare il downgrade di alcune richieste prioritarie all'elaborazione standard. Il servizio fattura le richieste elaborate dal livello di servizio standard a tariffe standard. Queste richieste non sono idonee per la destinazione di latenza di elaborazione prioritaria. Le richieste elaborate dal livello di servizio standard includono service_tier = default nella risposta.

Suggerimento

Se si riscontrano regolarmente limiti di frequenza di rampa, prendere in considerazione l'acquisto di PTU anziché o oltre all'elaborazione prioritaria.

Risoluzione dei problemi

| Problema | Motivo | Risoluzione |

|---|---|---|

| Errore HTTP 400 su richieste lunghe | gpt-4.1 non supporta le richieste che superano 128.000 token in elaborazione prioritaria. | Mantenere i token di richiesta totali sotto 128.000. Suddividere le richieste lunghe in richieste più piccole. |

| Richieste di cui è stato effettuato il downgrade al livello standard | Il traffico ha raggiunto più di 50% token al minuto in meno di 15 minuti, raggiungendo il limite di velocità di rampa. | Aumentare gradualmente il traffico. Prendere in considerazione l'acquisto di PTU per la capacità in stato stazionario. |

| Spillover PTU non funzionante | L'elaborazione prioritaria non supporta ancora lo spillover PTU in una distribuzione abilitata per l'elaborazione prioritaria. | Implementare logica di spillover personalizzata, ad esempio usando Gestione API di Azure. |

service_tier restituisce un valore non corretto durante lo streaming |

Quando si esegue lo streaming tramite l'API Risposte, service_tier potrebbe segnalare "priority" anche quando la richiesta è stata servita dal livello standard. |

Controllare i record di fatturazione per verificare quale livello ha effettivamente elaborato la richiesta. |

Supporto dell'API

| Versione dell'API | |

|---|---|

| Versione più recente dell'API di anteprima supportata: | 2025-10-01-preview |